Innehåll

15 oktober 2019Om du söker efter en smartphone med en bra kamera är det ingen tvekan om att du har sett Googles Pixel-serie på en lista med rekommendationer. År över år har Google kommit fram till hur man gör en kamera som ger fantastiska resultat varje gång. Från pixel-kikande techbloggaren till den vardagliga konsumenten är det svårt att hitta en enda person som inte älskar Pixels kameror.

Google försöker inte skapa kameror. Det försöker göra magi.

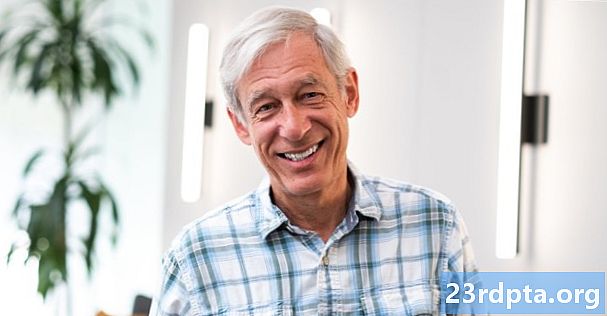

-

- Marc Levoy

-

- Isaac Reynolds

Jag fick nyligen möjligheten att sitta ner med Marc Levoy och Isaac Reynolds - kärnhjärnan bakom Pixel-seriens frustrerande bra kamerasystem. Vi hade långa samtal om de nya funktionerna i Pixel 4s kamera, från dess förbättrade Night Sight till dess WYSIWYG (What You See Is What You Get) i realtid HDR + -sökare. Det var mycket tekniskt prat om hur Google möjliggör dessa funktioner, men en sak gjordes kristallklar i slutet. Googles Pixel-kamera handlar inte alls om att försöka vara en kamera.

"Vår kärnfilosofi bygger en kamera som gör magi, vilket är den kombinationen av enkelhet och bildkvalitet," förklarade Reynolds, "Så Night Sight är fortfarande där, standard HDR + är fortfarande där. All behandling som pågår under huven för att få ett bra foto från standardläget finns fortfarande kvar. Och vi har också gjort mycket mer förenkling. "

Standardläge. Förenkling. Magi. Dessa är fraser som Google använder som en del av sin kärnfilosofi för Pixels kamera. I Levoy och Reynolds sinnen behöver inte fånga ögonblicket handla om lägesuppringningar och inställningsmenyer.Google försöker inte bygga en kamera i sin telefon, den försöker bygga något som gör konsekvent fantastiska bilder ut ur porten, på traditionella sätt eller på annat sätt.

Vad du ser är vad du får

![]()

En av Pixel 4: s nya funktioner är WYSIWYG-sökaren, vilket innebär att du kommer att se resultaten från HDR + innan du ens tar bilden. Detta kan verka som en mindre funktion, men det möjliggör vissa saker som helt enkelt inte är möjliga i kameror som inte är beräknade.

Målet med den WYSIWYG-sökaren är att minska användarens interaktion så mycket som möjligt. Genom att visa den resulterande bilden direkt när du öppnar kameran, vet du om du får en jämn exponering omedelbart, och kan bara fokusera på att spika ditt skott.

"Om vi ser att användaren knackade, vet vi att kameran inte gav dem vad de ville från början." Fortsätter Reynolds, "Så en kran, för mig, är potentiellt ett felfall som vi vill förbättra ”.

Traditionella kamerasystem är ganska dåliga på att få den bild du vill ha direkt ur kameran. Du kan antingen avslöja för höjdpunkterna och höja skuggorna senare, eller exponera för skuggorna men blåsa ut höjdpunkterna. Tack vare tekniken kan vi göra båda, och det är där beräkningsfotografering verkligen börjar få den magin att hända.

"Att ha en WYSIWYG-sökare nu betyder att vi kan tänka om hur du kontrollerar exponeringen på kameran om du vill." Säger Levoy, "Så om du trycker på, medan du innan du skulle få en reglage för exponeringskompensation får du nu två reglagen. Vi kallar den här funktionen Dubbel exponeringskontroll. Och det kan vara höjdpunkter och skuggor. Det kan vara ljusstyrka och dynamiskt intervall. Det finns många sätt att göra dessa två variabler. Vi har ställt in det för att göra ljusstyrka och skuggor. Och det ger dig en slags kontroll som ingen någonsin har haft på en kamera tidigare. ”

Du redigerar fotot innan du ens tar bilden.

Levoy har rätt. Dubbel exponeringskontroll är något som bara kan produceras genom beräkningsavbildning. Som en baslinje blir bilden jämn, med bevarade höjdpunkter och synliga skuggor. Men om du vill, kan du individuellt justera höjdpunkter och skuggor innan du ens tar fotot. Det är något du tidigare bara kunde göra i fotoredigeringsprogramvara efter att du tagit fotot.

Levoys team försöker se förbi de traditionella kamerans begränsningar genom att fokusera sina ansträngningar på de begränsningar som traditionella kameror har. Medan de flesta tillverkare introducerar Pro-lägen för att ge dig kontroll över bländare, slutartid och ISO, försöker Google automatiskt göra en bättre bild än du kunde, även om du hade de rattarna precis rätt.

Döda det med lärande

![]()

Så vilka andra sätt kan beräkningsmässigt avbilda traditionella kameratekniker utanför takten? I år tacklar Levoys team svagt ljus.

Pixel 4 introducerar inlärningsbaserad vitbalans i sitt kamerasystem. Den här funktionen arbetar för att kontinuerligt förbättra färgerna i dina bilder, även i extremt dåligt ljus. Google riktar sig specifikt mot svagt ljus och gult ljus och använde natriumånga-ljus som ett exempel på något den försöker fixa, men syftar till att få perfekt vitbalans varje gång.

Natriumdamplampor är en typ av gaslampa som ger en nästan monokrom effekt på motiv på grund av dess extremt smala våglängd 589nm till 589.3nm. De används för att de är en mycket effektiv ljuskälla, så att du ofta ser det i gatulampor eller andra lampor som måste hålla länge. Detta är en av de svåraste situationerna att få exakt vitbalans från, så Googles programvarufix är verkligen imponerande.

"Skulle vara gult när det gäller natriumångelys, och vi kommer att försöka neutralisera den dåliga belysningen," säger Levoy. ”Händer mycket i svagt ljus. Om du går in i ett diskotek och det finns röda neonljus kommer det att bevara det men kommer att försöka neutralisera en del av belysningen i negativa områden. ”

Inlärningsbaserad vitbalans fanns redan i Googles Night Sight-läge, varför dess slutliga bild hade mycket bättre färg än något som auto-läge på Huawei P30 Pro. Systemet lär sig baserat på bilder tagna på enheten det anser vara välbalanserade och använder den inlärda informationen för att producera mer färgnäta bilder under dåligt upplysta omständigheter. Detta är något som traditionella kamerasystem bara inte kan göra. När en kamera har skickats är vitvitbalans automatisk vitbalans. På Pixel fungerar det alltid för att bli bättre med tiden.

Inlärningsbaserad vitbalans gör fantastiska bilder med svag belysning ännu enklare, men Levoy vill använda datorer för att förenkla en en gång svår bildform - astrofotografering.

Se till stjärnorna

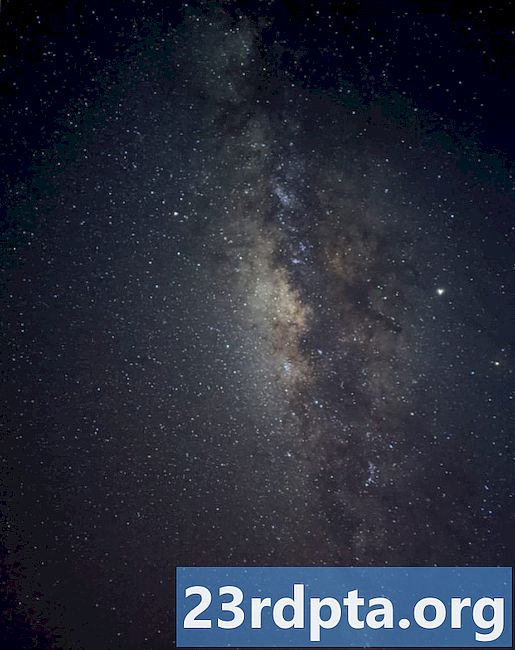

Källa: Google

Levoy kallar denna nya kapacitet ”HDR + på steroider”. Där standard HDR + tar en sprängning av 10-15 korta exponeringar och justerar och medelvärderar dem för att få skarpa bilder med lågt brus, tar detta nya läge upp till 15 uppsättningar av 16 sekunders exponeringar för att skapa en 4-minuters exponering. Systemet justerar sedan bilderna (eftersom stjärnorna rör sig över tiden) och justerar lämpliga inställningar och samtidigt minskar buller med pixelvärden för att skapa några häpnadsväckande bilder.

Detta var en slags helig gral för mig.

Marc LevoyLevoy visade mig några exempel på foton som hans team tog på mjölkvägen, och min käke tappade bokstavligen. Även om det är möjligt att göra långa exponeringar på traditionella kamerasystem, behöver du vanligtvis extra utrustning för att vända kameran över tid om du vill ha extra skarpa bilder. Med Night Sight kan du helt enkelt stötta telefonen mot en sten, slå i slutaren och enheten gör resten.

Kanske är den smartaste delen av det här nya Astro Night Sight-läget att det inte är ett separat läge alls. Allt händer med Night Sight-knappen. HDR + använder redan gyroskopet för att upptäcka rörelse och justera bilderbrister, och Night Sight kommer nu att upptäcka hur lång tid det kan ta en bild beroende på hur stabil enheten är när du trycker på avtryckaren, upp till fyra minuter. Det kommer också att upptäcka himmel med en metod som kallas Semantic Segmentation, vilket gör att systemet kan behandla vissa områden i bilden på ett annorlunda sätt för bästa resultat.

-

- Källa: Google

-

- Källa: Google

"Vi vill att saker ska vara lätta för alla att använda," säger Reynolds. "Så när vi hittar något i produkten som inte behöver vara där, kan vi ta det ansvaret från dig och lösa det åt dig."

Detta uttalande bygger verkligen på vad Google försöker göra med Pixels kamera. I stället för att se hur de kan få den att fungera som en kamera försöker Google lösa problem som du inte ens visste att det fanns och presentera det i enklast möjliga form.

Naturligtvis finns det meriter för båda sidor. Vissa människor kanske vilja en telefonkamera som fungerar som en kamera med manuella kontroller och ratt. De kanske vill ha större sensorer och Pro-lägen. Men medan andra ODM: er nästan enbart fokuserar på hårdvara, ser Google i en helt annan riktning.

Det ser ut att göra magi.

Vill du lära dig mer om datorfotografering? Kolla in videon ovan för att se hur det här fältet kommer att förändra hur vi gör bilder.

Pixel 4